效能:

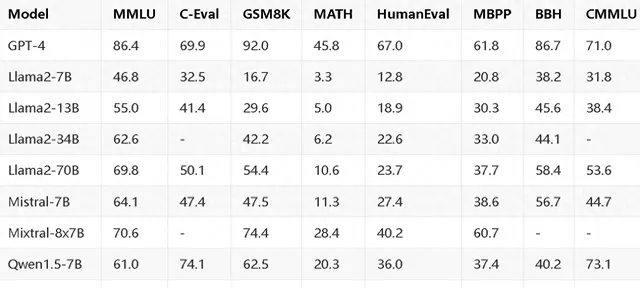

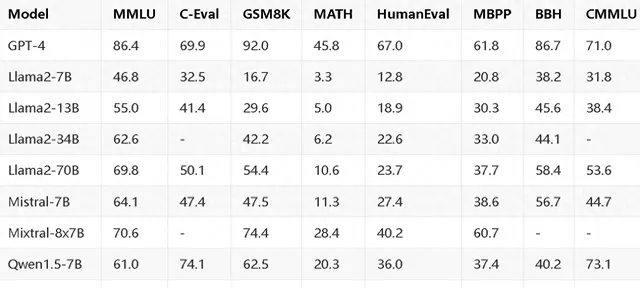

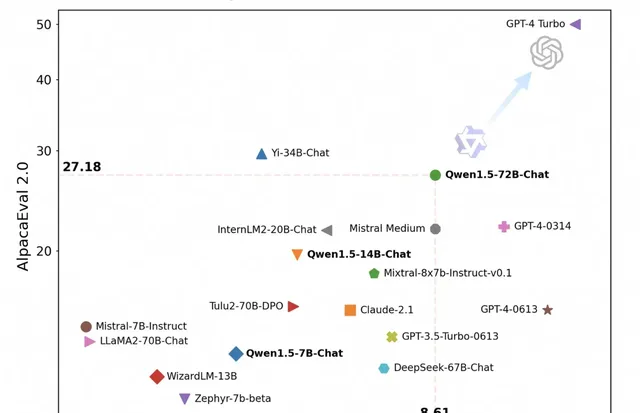

效能評價如下(72B 好於Mixtral-8x7B ):

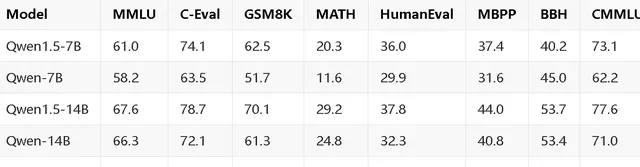

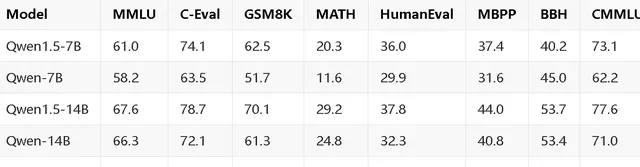

也比自己一代模型強一些,好些不是很多:

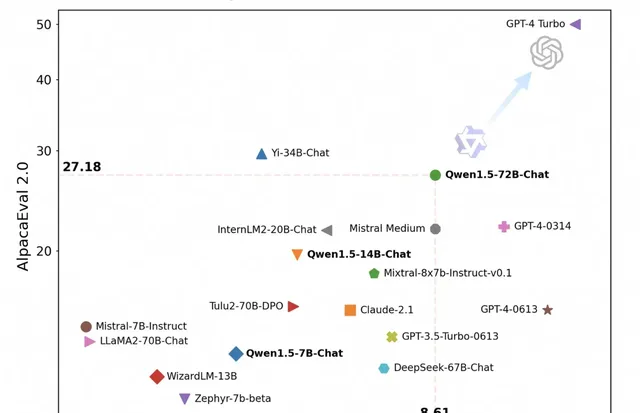

綜合對比:

HuggingFace原生

Qwen1.5 這次直接與HuggingFace transformers整合結合,不需要再載入任何自訂的程式碼(trust_remote_code)不需要了。

size 全

地址:

效能:

效能評價如下(72B 好於Mixtral-8x7B ):

也比自己一代模型強一些,好些不是很多:

綜合對比:

HuggingFace原生

Qwen1.5 這次直接與HuggingFace transformers整合結合,不需要再載入任何自訂的程式碼(trust_remote_code)不需要了。

size 全

地址:

Copyright © 2024 www.digfamily.com NO.1 華文頭條

商務合作:xingwa#jasve.com(傳送郵件請將#換成@)